Der Fortschritt in der Welt der Künstlichen Intelligenz (KI) ist atemberaubend und bietet stetig neue Möglichkeiten. Am 26. Juli 2023 wurde SDXL 1.0 als neues Basis-Model von Stable Diffusion veröffentlicht. Wir haben uns die Zeit genommen, das neue Bildgenerierungs-Model ausgiebig auszuprobieren. Soviel vorweg: Definitiv Gamechanger! Hier teilen wir unsere Eindrücke:

1. Handhabung und Integration

Leider ist die Handhabung von SDXL 1.0 momentan noch etwas holprig. Die Integration in Automatic1111 könnte noch etwas Feinschliff gebrauchen. Für diejenigen, die eine alternative Route wählen möchten, steht das node-basierte ComfyUI zur Verfügung. Hierbei handelt es sich jedoch um ein eher komplexes Interface, welches Anfänger vielleicht abschrecken könnte.

2. Bildqualität

Das Herzstück eines jeden Bildgenerierungs-Models. Und hier punktet SDXL 1.0 gewaltig! Die Bildqualität ist phänomenal. Selbst ohne feines Tuning liefert das Modell bereits mit einfachen Prompts brillante Ergebnisse. Ein besonderes Highlight ist die feste Integration von Offset Noise im Training, wodurch Bilder entstehen, die in Sachen Kontrast mit denen des Konkurrenten Midjourney mithalten können.

3. Prompting

Ein wesentlicher Vorteil des neuen SDXL 1.0 ist das verbesserte Textverständnis. Dies spart nicht nur Zeit, sondern auch Nerven. Besonders hervorzuheben ist, dass die Tage der langen, umständlichen negativen Prompts aus Stable Diffusion 1.5 Zeiten gezählt sind. Nun kann man sich wirklich auf das Wesentliche konzentrieren, was den Prozess erheblich beschleunigt.

SDXL 1.0 Testreihe mit negative Prompt:

SDXL 1.0 Testreihe ohne negative Prompt:

Prompt: medium shot photo of a happy 40 year old business woman with ginger hair, freckles, munich, beautiful detailed face, dramatic lighting, 50mm, F1.8, film grain, chromatic aberations, analog photography

Negative: animation,doll,anime,painting,cartoon,drawing,illustration,3d,sketch,surreal,(cropped head), (cropped body),out of frame,crossed eyes, bad hands,((disfigured)),((deformed)),strange anatomy,(bad proportions),((extra limbs)),(ugly),((b&w)),weird colors,blurry,((monochrome)),lowres,(low quality:2),jpeg artifacts

4. Training

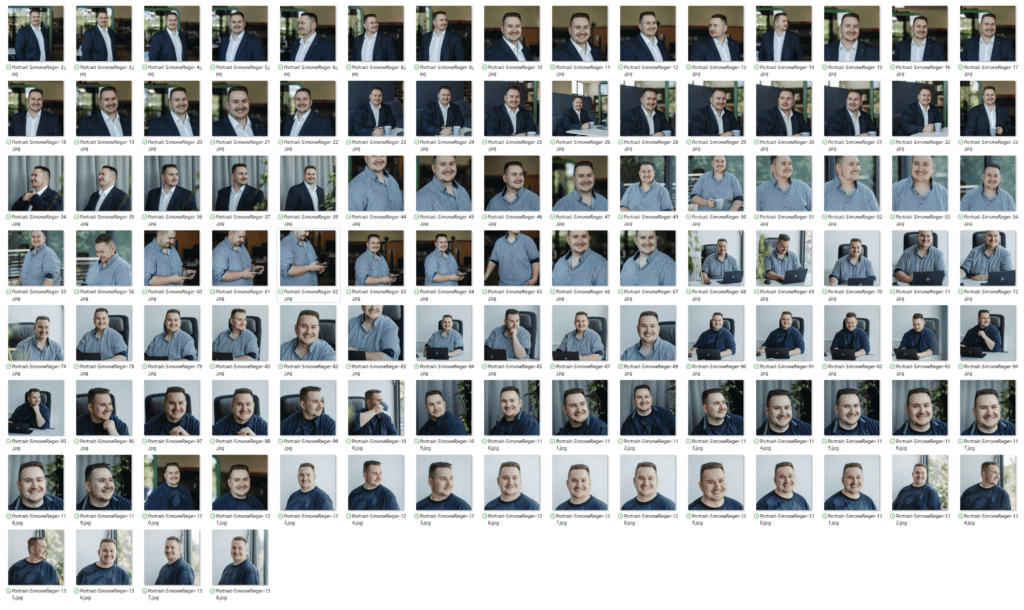

Einfach beeindruckend! Wir haben den ultimativen Test gemacht: Georg Neumann hat basierend auf 109 Fotos ein eigenes SDXL 1.0 Model trainiert. Ohne aufwändiges Captioning oder sorgfältige Bildauswahl entstand in nur 10.000 Steps ein hochwertiges Modell.

Trainingsdaten:

Testgenerierungen

Georgs Reaktion?

„Wow! Wenn das nur der Anfang ist, bin ich gespannt, wo wir in ein paar Monaten sein werden, besonders wenn wir mit bereits feingetunten Models aus der Community arbeiten können.“

Unser Fazit zu SDXL 1.0

Die Zeichen stehen auf Innovation. SDXL 1.0 ist nicht einfach nur ein neues Update – es markiert einen bedeutenden Schritt nach vorne. Dies spiegelt sich auch in der begeisterten Aufnahme durch die Open-Source-Community wider. Sogar eingefleischte Fans von Stable Diffusion 1.5 erkennen das Potential und wechseln bereits. Mit den ständig erscheinenden, hochwertigen Embeddings und feingetunten Models steht der KI-Bildgenerierung eine strahlende Zukunft bevor.